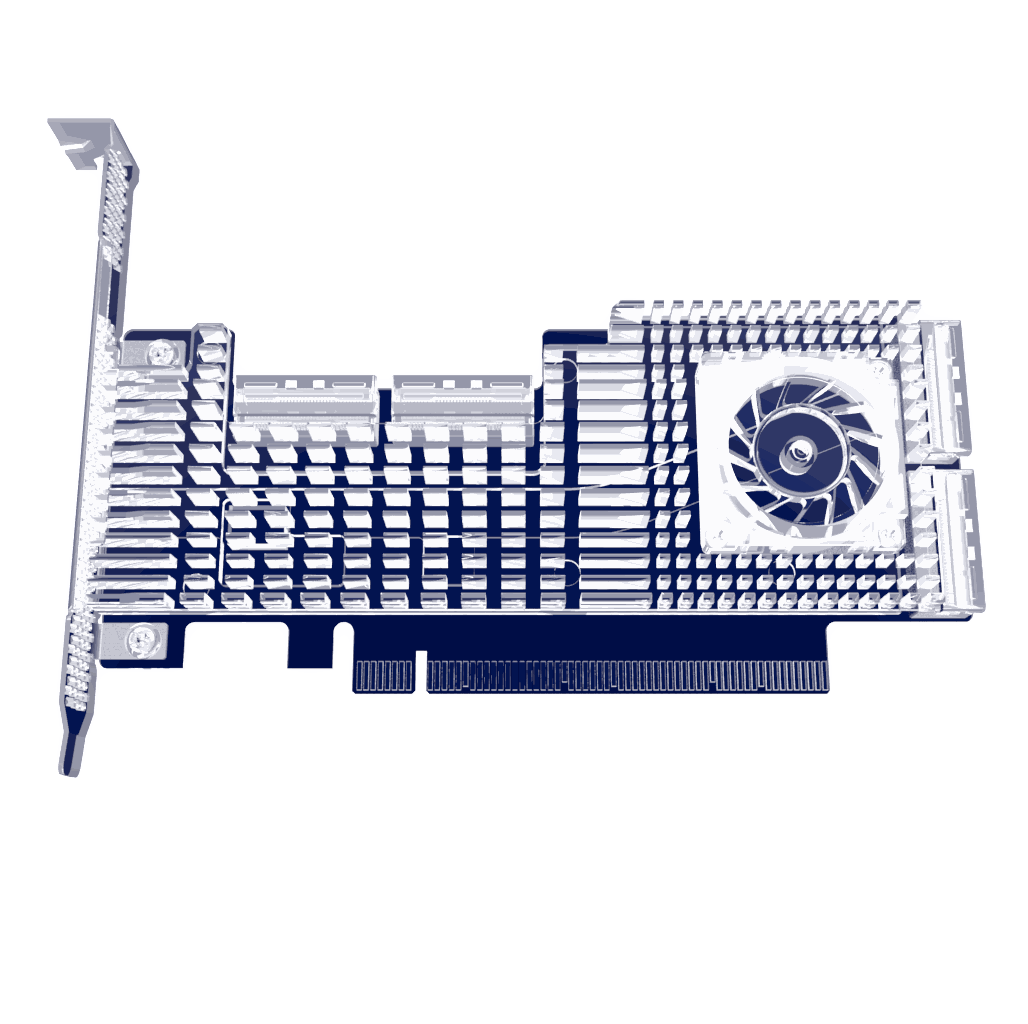

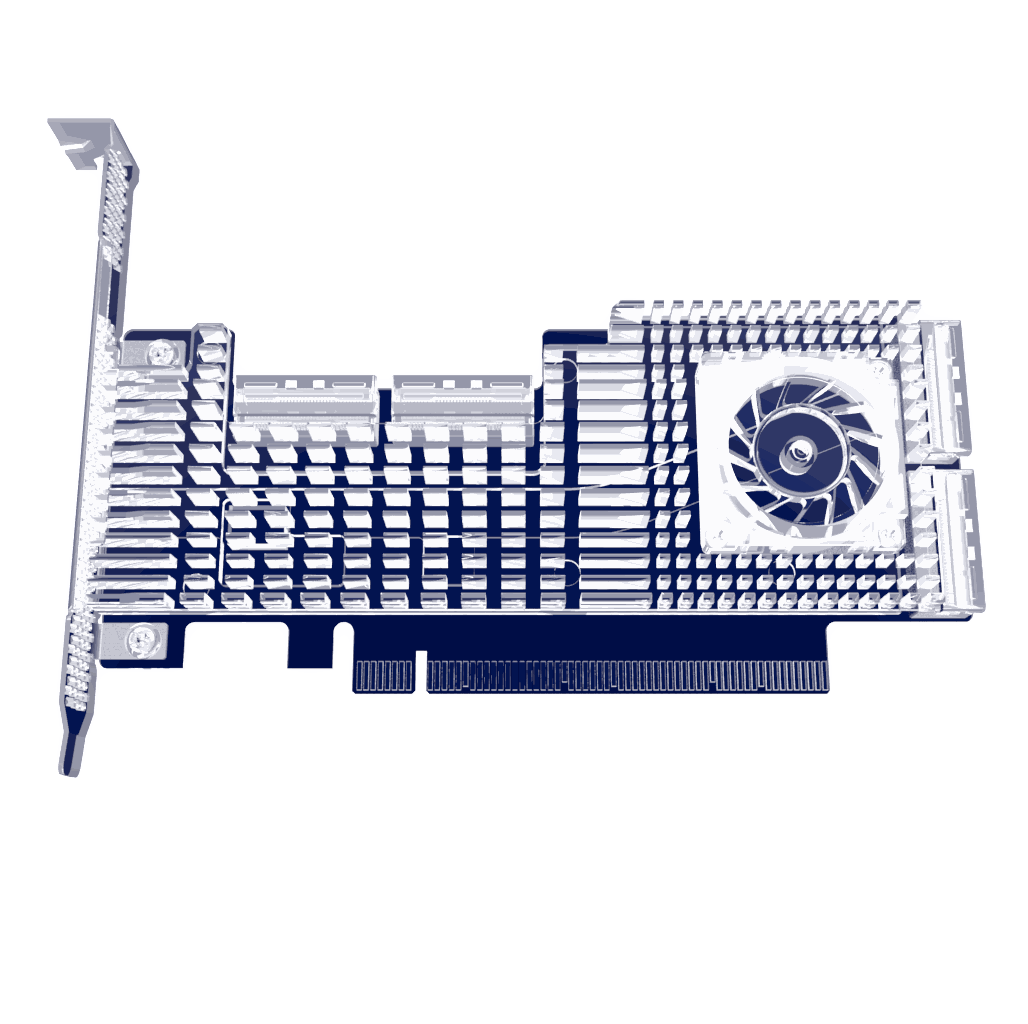

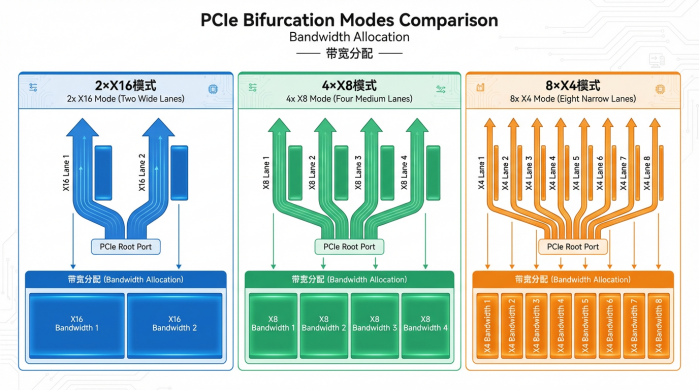

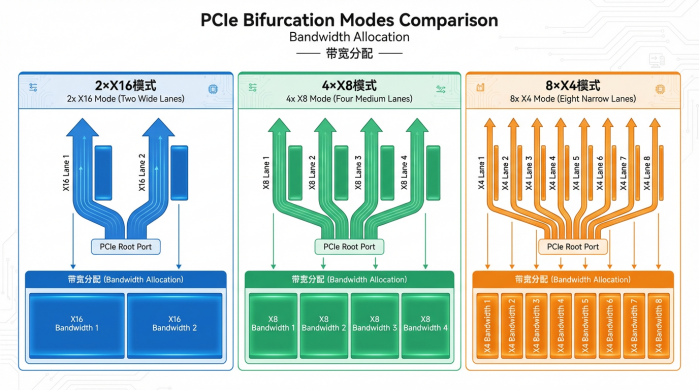

Mit der rasanten Entwicklung des Trainings großer KI-Modelle, des High-Performance-Computings und des Cloud-Computings ist die Nachfrage der Unternehmen nach GPU-Rechenleistung und Speicherleistung von Servern explosionsartig angestiegen. Herkömmliche Serverarchitekturen weisen jedoch viele Engpässe bei den Erweiterungsmöglichkeiten auf, wie z. B. begrenzte PCIe-Steckplätze, Schwierigkeiten beim Ausgleich von GPU- und SSD-Einsatz und mangelnde Flexibilität bei Erweiterungslösungen. Diese Probleme haben die geschäftliche Innovation stark eingeschränkt. In diesem Beitrag werden diese Probleme der Branche eingehend analysiert und es wird gezeigt, wie LR-LINK LRSV9500-4I bietet Unternehmen durch die flexiblen X4/X8/X16-Bifurkationsmodi eine Erweiterungslösung aus einer Hand.

Vergleich Dimension | Traditionelle Lösung | LRSV9500-4I Lösung |

Expansionsfähigkeit | 1 Steckplatz = 1 Gerät | 1 Steckplatz = 8 SSDs oder 2 GPUs |

Flexibilität bei der Konfiguration | Feste Funktion | Umschaltbare X4/X8/X16-Modi |

GPU- und SSD-Ausgleich | Es ist schwierig, sich gleichzeitig zu treffen | Perfekte Unterstützung im X8-Modus |

PCIe 5.0-Unterstützung | Teilweise Unterstützung | Volle 32GT/s-Unterstützung |

Multi-GPU-Verbindung | Verlassen Sie sich auf die CPU-Weiterleitung | P2P-Kommunikation |

II.Typische Anwendungsfälle in der Industrie

2.1 KI-Rechenzentrum: 8-GPU-Trainingscluster

Ein KI-Unternehmen hat eine fortschrittliche Trainingsplattform für große Modelle gebaut, die den X16-Modus des LRSV9500-4I zur Erweiterung der GPUs nutzt. 8 GPUs sind über 4 miteinander verbunden LRSV9500-4I Karten. Diese Konfiguration verbessert die GPU-Nutzung und die Trainingseffizienz erheblich.

2.2 Internet-Rechenzentrum: All-Flash-Speicherpool

Ein verteilter Speichercluster wird mit dem X4-Modus des LRSV9500-4I aufgebaut, so dass ein einzelner Server 8 U.2 NVMe-SSDs mit einer Gesamtkapazität von 128 TB und einer aggregierten Bandbreite von mehr als 50 GB/s unterstützt. Die Anwendung dieser Technologie hat die Skalierbarkeit und Leistung des Systems erheblich verbessert, wobei die Leistung von Datenbankabfragen um das Zehnfache gesteigert werden konnte.

2.3 Grafik-Workstation: Hybride GPU- und Speicherkonfiguration

In der Film- und Fernsehproduktion werden Workstations im X8-Modus konfiguriert, die mit 2 Grafikkarten ausgestattet sind, die bei Echtzeit-Rendering-Tests hervorragende Leistungen erbringen und die Rendering- und Exporteffizienz deutlich verbessern können. Darüber hinaus gewährleistet die Konfiguration von 2 NVMe-SSDs eine hohe Lese- und Schreibgeschwindigkeit bei der Materialspeicherung. Professionelle Leistungstests zeigen, dass die Rendering-Geschwindigkeit von 4K-Videomaterial im Vergleich zu herkömmlichen Konfigurationen um mehr als 80 % erhöht und die Exportzeit von High-Definition-Videos um 60 % reduziert wird.

2.4 Rechenplattform für die wissenschaftliche Forschung: Heterogene Rechenknoten

Das Supercomputing Center nutzt LRSV9500-4I heterogene Rechenknoten, um das parallele Rechnen von GPUs im X16-Modus und die effiziente Verbindung von FPGA-Beschleunigungskarten und NVMe-Speicher im X8-Modus zu realisieren. Diese flexible Konfigurationsmethode von Rechen-, Netzwerk- und Speicherkapazität hat die Ressourcennutzung um 40 % deutlich verbessert.

III.LRSV9500-4I Vorschläge zur Auswahl und Konfiguration

3.1 Auswahl des Bifurkationsmodus je nach Anwendungsszenario

· In reinen KI-Trainingsszenarien wird empfohlen, den X16-Modus zu wählen, um die Single-GPU-Bandbreite zu maximieren und somit High-End-Grafikkarten zu unterstützen.

· In reinen Speicherszenarien kann der X4-Modus gewählt werden, um die Anzahl der SSDs zu maximieren und ein All-Flash-Array mit hoher Dichte aufzubauen.

· Für gemischte Lastszenarien kann der X8-Modus ausgewählt werden, um die GPU- und SSD-Konfiguration auszugleichen und so eine optimale Ressourcenzuweisung zu erreichen.

3.2 Wichtige Bewertungsindikatoren

· Motherboard-Kompatibilität: Stellen Sie sicher, dass das Motherboard PCIe 5.0 unterstützt.

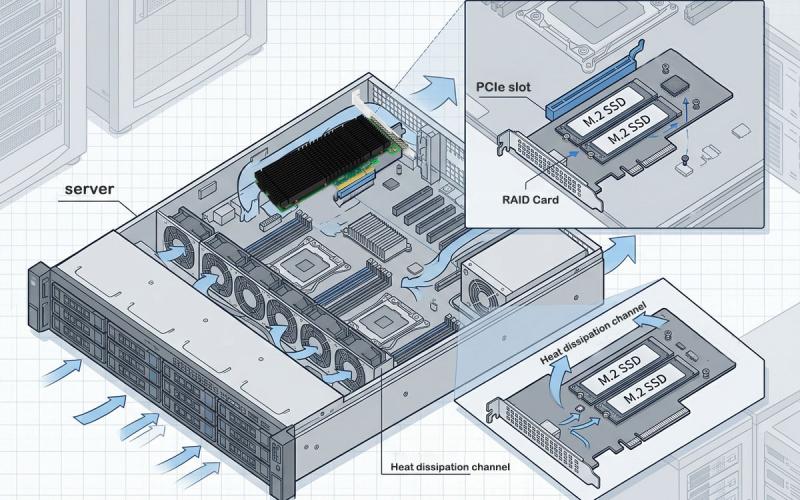

· Platz im Gehäuse: LRSV9500-4I ist ein halbhohes Design, kompatibel mit Servern von 2U und höher

· Bedingungen für die Wärmeableitung: Stellen Sie sicher, dass die Luftkanäle des Servers frei sind, und fügen Sie bei Bedarf zusätzliche Maßnahmen zur Wärmeabfuhr hinzu.

· Kabelqualität: Verwenden Sie zertifizierte Hochgeschwindigkeits-MCIO-Kabel, um die Integrität der PCIe 5.0-Signale zu gewährleisten.

IV.Ausblick auf technologische Entwicklungstrends

Mit der Veröffentlichung der PCIe 6.0-Spezifikation hat die Übertragungsrate 64 GT/s pro Kanal erreicht. Die Reife dieser Technologie in Verbindung mit der Entwicklung der CXL-Technologie wird neue Entwicklungsmöglichkeiten für PCIe-Switch-Erweiterungskarten bieten. Die Entwicklung der CXL-Technologie, insbesondere die Unterstützung von CXL 2.0 für Speicherpooling und Switch-Architektur, wird die Rolle von PCIe-Switch erweitern, die nicht mehr auf GPU- und Speichererweiterung beschränkt sein wird, sondern eine wichtige Rolle bei der Speichererweiterung übernehmen wird.

Gleichzeitig wird mit dem kontinuierlichen Wachstum der Parameter von KI-Großmodellen die Nachfrage nach GPU-Verbindungsbandbreite immer dringender, was aus dem signifikanten Wachstum des Marktumfangs der KI-Großmodellindustrie und technologischen Durchbrüchen ersichtlich wird. Die Multi-Maschinen-Verbindungsfähigkeit des PCIe-Switches, die durch die NTB-Funktion realisiert wird, wird zu einer Schlüsseltechnologie für den Aufbau großer KI-Trainingscluster. LR-LINK wird weiterhin in Forschung und Entwicklung investieren, um den Kunden fortschrittlichere Erweiterungslösungen anzubieten.

Zusammenfassung

Die Probleme der Server-GPU- und Speichererweiterung sind im Wesentlichen der Widerspruch zwischen begrenzten Ressourcen und unbegrenzter Nachfrage. Durch die PCIe-Switch-Technologie und die flexiblen X4/X8/X16-Bifurkationsmodi bietet LRSV9500-4I Unternehmen einen effizienten Lösungsweg. Ob für KI-Schulungen, High-Performance-Computing, Big-Data-Analysen oder Videoproduktion, LRSV9500-4I bietet hervorragende Erweiterungsmöglichkeiten und Investitionsschutz.

Als LR-LINKs Flaggschiffprodukt im Bereich PCIe 5.0 wird LRSV9500-4I, das sich auf die führende Leistung des Broadcom PEX89048 Chips und die perfekte Unterstützung des Ökosystems stützt, zur bevorzugten Erweiterungslösung für den Aufbau von KI-Servern und Rechenzentren. Die Entscheidung für LRSV9500-4I bedeutet die Entscheidung für eine flexible, effiziente und zukunftsorientierte Erweiterungsarchitektur.