I. O que é a rede InfiniBand?

O InfiniBand, geralmente abreviado como "IB", é um padrão de comunicação de rede e um dos protocolos que implementam a tecnologia RDMA (Remote Direct Memory Access). Ele utiliza tecnologia de sinalização diferencial de alta velocidade e mecanismos de transmissão paralela multicanal. Seus principais objetivos são fornecer "alto desempenho, baixa latência e alta confiabilidade".

A InfiniBand é uma tecnologia de interconexão dedicada à computação de alto desempenho (HPC) no domínio do servidor. Ela apresenta taxa de transferência extremamente alta e latência excepcionalmente baixa, usada para interconexão de dados entre computadores (por exemplo, replicação, cargas de trabalho distribuídas). A InfiniBand também é empregada como uma interconexão direta ou comutada entre servidores e sistemas de armazenamento (como SANs e armazenamento de conexão direta), bem como entre os próprios sistemas de armazenamento. Além disso, facilita a comunicação entre servidores e redes (como LANs, WANs e a Internet). Ele é amplamente usado em data centers e campos de HPC/armazenamento. Posteriormente, com o surgimento da inteligência artificial, ela se tornou a tecnologia de interconexão de rede preferida para conectar servidores de GPU.

II. O histórico de desenvolvimento da InfiniBand

No início dos anos 90, a Intel foi pioneira na introdução do design do barramento PCI na arquitetura padrão do PC para dar suporte ao crescente número de dispositivos externos. No entanto, à medida que as CPUs, a memória, os discos rígidos e outros componentes eram rapidamente atualizados, a evolução mais lenta do barramento PCI tornou-se um gargalo para todo o sistema. Para resolver esse problema, gigantes do setor de TI, como Compaq, Dell, HP, IBM, Intel, Microsoft e Sun, juntamente com mais de 180 outras empresas, fundaram em conjunto a **IBTA (InfiniBand Trade Association)**.

O objetivo da IBTA era pesquisar novas tecnologias alternativas para substituir a PCI e resolver seu problema de gargalo de transmissão. Consequentemente, em 2000, a **InfiniBand Architecture Specification versão 1.0** foi oficialmente lançada. Ela introduziu o protocolo RDMA, oferecendo menor latência, maior largura de banda, maior confiabilidade e permitindo um desempenho de E/S significativamente mais poderoso, estabelecendo-o como um novo padrão para a tecnologia de interconexão de sistemas.

Falar de InfiniBand inevitavelmente leva a uma empresa israelense - **Mellanox** (nome chinês: , facilmente lembrado como - "vendendo parafusos"). Fundada em Israel, em maio de 1999, por vários ex-funcionários da Intel e da Galileo Technology, a Mellanox entrou para a aliança do setor de InfiniBand logo após sua criação. Em 2001, a empresa lançou seu primeiro produto InfiniBand.

Em 2002, o campo da InfiniBand enfrentou uma grande reviravolta. A Intel "abandonou o barco", decidindo mudar seu foco de desenvolvimento para o **PCI Express (PCIe)**, que foi lançado em 2004. Outra gigante, a Microsoft, também se retirou do desenvolvimento do InfiniBand. Embora empresas como a Sun e a Hitachi continuassem comprometidas, o futuro da InfiniBand foi ofuscado.

A partir de 2003, a InfiniBand passou a se concentrar em um novo domínio de aplicativos: "interconexão de clusters de computadores". Em 2005, ela encontrou outro novo aplicativo: "conectividade de dispositivos de armazenamento". Depois de 2012, impulsionada pelo crescimento contínuo das demandas de computação de alto desempenho (HPC), a tecnologia InfiniBand avançou, aumentando constantemente sua participação no mercado.

À medida que a tecnologia InfiniBand foi ganhando destaque, a Mellanox também cresceu e se tornou a"líder de mercado" em InfiniBand. Em 2010, a Mellanox se fundiu com a Voltaire, deixando a Mellanox (adquirida pela NVIDIA em 2019) e a QLogic (adquirida pela Intel em 2012) como os principais fornecedores de InfiniBand.

Em 2013, a Mellanox adquiriu a empresa de tecnologia de fotônica de silício Kotura e a fabricante de chips de interconexão óptica paralela IPtronics, solidificando ainda mais seu portfólio do setor.

Em 2015, a participação da tecnologia InfiniBand no mercado de"TOP500" A lista de supercomputadores ultrapassou 50% pela primeira vez. Isso marcou a superação inicial da tecnologia Ethernet pela InfiniBand, que se tornou a"tecnologia de interconexão de cluster preferida para supercomputadores".

Em 2015, a Mellanox detinha um"80% de participação" do mercado global de InfiniBand. Seu escopo de negócios havia se expandido dos chips para abranger todo o espectro: adaptadores de rede, switches/gateways, sistemas de comunicação remota e cabos/módulos, estabelecendo-os como um provedor de rede de classe mundial.

Em 2019, a NVIDIA fez uma mudança significativa, adquirindo a Mellanox por"US$ 6,9 bilhões". Jensen Huang, CEO da NVIDIA, declarou: "Esta é a união de duas empresas líderes mundiais em computação de alto desempenho. A NVIDIA se concentra em computação acelerada, enquanto a Mellanox se concentra em interconexão e armazenamento". Em retrospectiva, a NVIDIA demonstrou uma previsão notável: o treinamento de modelos grandes depende muito de clusters de computação de alto desempenho, e as redes InfiniBand são a base para a criação de um sistema de interconexão e armazenamento."parceiro ideal" para esses clusters.

III. Como funciona o InfiniBand

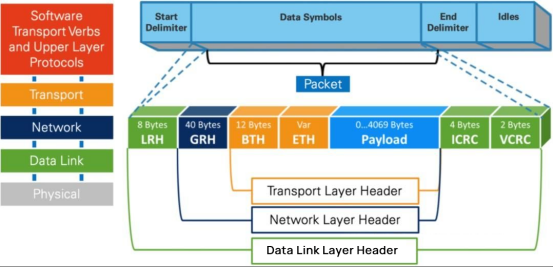

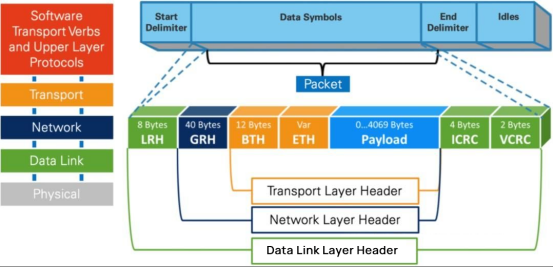

Os princípios de funcionamento do InfiniBand podem parecer complexos para quem não é especializado em redes. Os iniciantes podem entender os princípios básicos ou pular esta seção. O protocolo InfiniBand também adota um"arquitetura em camadas"Cada camada é independente e fornece serviços para a camada acima dela.

Camada física: Define como os sinais de bits são reunidos em símbolos no link físico e, em seguida, em quadros, símbolos de dados e preenchimento de dados entre pacotes. Detalha os protocolos de sinalização para a construção de pacotes válidos, etc.

Camada de link: Define o formato dos pacotes de dados e os protocolos para operações de pacotes, como controle de fluxo, roteamento, codificação, decodificação etc.

Camada de rede: Realiza o roteamento adicionando um cabeçalho de rota global (GRH) de 40 bytes ao pacote. Durante o encaminhamento, os roteadores executam apenas uma verificação CRC variável, garantindo"integridade da transmissão de dados de ponta a ponta".

Camada de transporte: entrega pacotes a um par de filas (QP) específico e instrui o QP sobre como processar o pacote. O transporte da rede InfiniBand emprega a tecnologia CBFC (Credit-Based Flow Control, controle de fluxo baseado em crédito) para garantir a confiabilidade e a eficiência da transmissão de dados. Esse mecanismo gerencia o crédito (que representa o volume de dados que o receptor pode aceitar) entre o remetente e o receptor para evitar a perda de pacotes e o congestionamento.

O QP (Queue Pair, par de filas) é a unidade de comunicação fundamental na tecnologia RDMA. Ele consiste em um par de filas: a SQ (Send Queue) e a RQ (Receive Queue). Quando os usuários chamam as APIs para enviar ou receber dados, eles basicamente colocam os dados no QP. As solicitações no QP são então processadas uma a uma em uma maneira de polling.

As vantagens de"CBFC" A tecnologia pode ser resumida em três pontos principais:

1. Evita o congestionamento: Por meio do ajuste dinâmico de crédito e da transmissão sem perdas, o CBFC evita efetivamente o congestionamento da rede e a perda de pacotes.

2. Aumenta a eficiência: o remetente pode transmitir dados continuamente sem esperar por confirmações até que o crédito se esgote, aumentando assim a eficiência da transferência de dados.

3. configuração automática: o mecanismo de controle de fluxo é ativado automaticamente na instalação física dos dispositivos InfiniBand, não exigindo configuração manual do usuário.

Como é evidente, o InfiniBand define seus próprios formatos de Camada 1-4 (Física, Link, Rede, Transporte), constituindo um protocolo de rede completo. O controle de fluxo de ponta a ponta é a base para o envio e recebimento de pacotes de rede InfiniBand, permitindo a realização de uma rede sem perdas altamente eficaz.

Obviamente, a obtenção da rede InfiniBand de alta velocidade e sem perdas também depende de tecnologias e recursos como Socket Direct, Adaptive Routing, Subnet Manager (SM) para gerenciamento de sub-rede, particionamento de rede e o mecanismo SHARP (Scalable Hierarchical Aggregation and Reduction Protocol) para otimização de rede. Juntos, esses componentes proporcionam seu característico alto desempenho, baixa latência e fácil escalabilidade.