I.¿Qué es la red InfiniBand?

InfiniBand, a menudo abreviado como "IB", es un estándar de comunicación de red y uno de los protocolos que implementan la tecnología RDMA (Acceso Remoto Directo a Memoria). Utiliza tecnología de señalización diferencial de alta velocidad y mecanismos de transmisión paralela multicanal. Sus objetivos principales son ofrecer "alto rendimiento, baja latencia y alta fiabilidad".

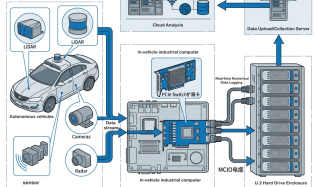

InfiniBand es una tecnología de interconexión dedicada a la informática de alto rendimiento (HPC) en el ámbito de los servidores. Se caracteriza por un rendimiento extremadamente alto y una latencia excepcionalmente baja, y se utiliza para la interconexión de datos entre ordenadores (por ejemplo, replicación, cargas de trabajo distribuidas). InfiniBand también se emplea como interconexión directa o conmutada entre servidores y sistemas de almacenamiento (como SAN y almacenamiento de conexión directa), así como entre los propios sistemas de almacenamiento. Además, facilita la comunicación entre servidores y redes (como LAN, WAN e Internet). Su uso está muy extendido en los centros de datos y en los campos de HPC/almacenamiento. Posteriormente, con el auge de la inteligencia artificial, se ha convertido en la tecnología de interconexión de redes preferida para conectar servidores GPU.

II. Historia del desarrollo de InfiniBand

A principios de la década de 1990, Intel fue pionera en la introducción del diseño del bus PCI en la arquitectura estándar de los PC para dar soporte al creciente número de dispositivos externos. Sin embargo, a medida que las CPU, la memoria, los discos duros y otros componentes se actualizaban rápidamente, la evolución más lenta del bus PCI se convirtió en un cuello de botella para todo el sistema. Para solucionar este problema, gigantes del sector informático como Compaq, Dell, HP, IBM, Intel, Microsoft y Sun, junto con más de 180 empresas, fundaron conjuntamente la **IBTA (InfiniBand Trade Association)**.

El objetivo de IBTA era investigar nuevas tecnologías alternativas para sustituir a PCI y resolver su problema de cuello de botella en la transmisión. En consecuencia, en 2000 se publicó oficialmente la **Especificación de Arquitectura InfiniBand versión 1.0**. Introdujo el protocolo RDMA, que ofrece menor latencia, mayor ancho de banda, mayor fiabilidad y permite un rendimiento de E/S significativamente más potente, estableciéndolo como un nuevo estándar para la tecnología de interconexión de sistemas.

Hablar de InfiniBand conduce inevitablemente a una empresa israelí: **Mellanox** (nombre chino: , fácilmente recordado como - "vender tornillos"). Fundada en Israel en mayo de 1999 por varios antiguos empleados de Intel y Galileo Technology, Mellanox se unió a la alianza industrial InfiniBand poco después de su creación. En 2001 lanzaron su primer producto InfiniBand.

En 2002, el campo de InfiniBand se enfrentó a una gran convulsión. Intel "abandonó el barco" y decidió centrar su desarrollo en **PCI Express (PCIe)**, que se lanzó en 2004. Otro gigante, Microsoft, también se retiró del desarrollo de InfiniBand. Aunque empresas como Sun e Hitachi mantuvieron su compromiso, el futuro de InfiniBand quedó ensombrecido.

A partir de 2003, InfiniBand pivotó hacia un nuevo ámbito de aplicación: "interconexión de clústeres informáticos". En 2005, encontró otra nueva aplicación: "conectividad de dispositivos de almacenamiento". A partir de 2012, impulsada por el continuo crecimiento de la demanda de computación de alto rendimiento (HPC), la tecnología InfiniBand se disparó, aumentando constantemente su cuota de mercado.

A medida que la tecnología InfiniBand iba adquiriendo importancia, Mellanox también creció y se convirtió en el"líder del mercado" en InfiniBand. En 2010, Mellanox se fusionó con Voltaire, dejando a Mellanox (adquirida por NVIDIA en 2019) y QLogic (adquirida por Intel en 2012) como principales proveedores de InfiniBand.

En 2013, Mellanox adquirió la empresa de tecnología fotónica de silicio Kotura y el fabricante de chips de interconexión óptica paralela IPtronics, consolidando aún más su cartera sectorial.

En 2015, la cuota de la tecnología InfiniBand en el"TOP500" superó por primera vez el 50% de la lista de superordenadores. Esto marcó el adelantamiento inicial de InfiniBand a la tecnología Ethernet, convirtiéndose en el"tecnología de interconexión de clústeres preferida para superordenadores".

En 2015, Mellanox contaba con un"80% de participación" del mercado mundial de InfiniBand. Su ámbito de negocio había pasado de los chips a abarcar todo el espectro: adaptadores de red, conmutadores/gateways, sistemas de comunicación remota y cables/módulos, lo que los consolidó como proveedores de redes de categoría mundial.

En 2019, NVIDIA hizo un movimiento importante, adquiriendo Mellanox por"6.900 millones de dólares". Jensen Huang, Consejero delegado de NVIDIA, ha declarado: "Ésta es la unión de dos compañías líderes mundiales en computación de alto rendimiento. NVIDIA se centra en el cálculo acelerado y Mellanox, en la interconexión y el almacenamiento". En retrospectiva, NVIDIA demostró una notable previsión: el entrenamiento de grandes modelos depende en gran medida de clusters de computación de alto rendimiento, y las redes InfiniBand son el"socio óptimo" para dichas agrupaciones.

III. Funcionamiento de InfiniBand

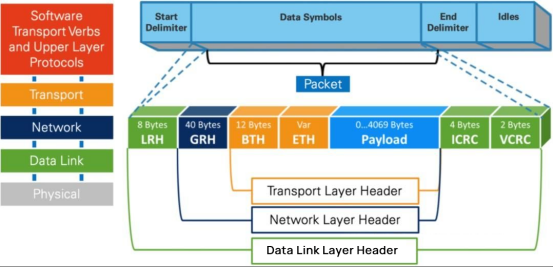

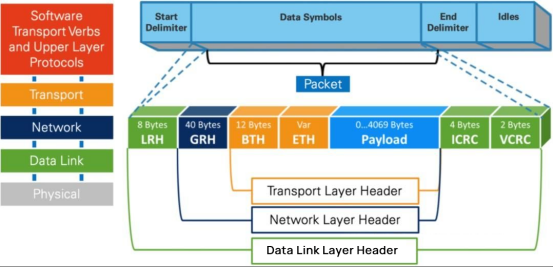

Los principios de funcionamiento de InfiniBand pueden parecer complejos para quienes no son especialistas en redes. Los principiantes pueden comprender lo básico o saltarse esta sección. El protocolo InfiniBand también adopta un"arquitectura en capas"Cada capa es independiente y presta servicios a la capa superior.

Capa física: Define cómo las señales de bits se ensamblan en símbolos en el enlace físico, luego en tramas, símbolos de datos y relleno de datos entre paquetes. Detalla los protocolos de señalización para construir paquetes válidos, etc.

Capa de enlace: Define el formato de los paquetes de datos y los protocolos para las operaciones con paquetes, como control de flujo, enrutamiento, codificación, descodificación, etc.

Capa de red: Realiza el enrutamiento añadiendo una cabecera de ruta global (GRH) de 40 bytes al paquete. Durante el reenvío, los enrutadores sólo realizan una comprobación CRC variable, garantizando"integridad de la transmisión de datos de extremo a extremo".

Capa de transporte: entrega paquetes a un par de colas (QP) específico e indica al QP cómo procesar el paquete. El transporte de red InfiniBand emplea la tecnología de control de flujo basado en créditos (CBFC) para garantizar la fiabilidad y eficiencia de la transmisión de datos. Este mecanismo gestiona el crédito (que representa el volumen de datos que el receptor puede aceptar) entre el emisor y el receptor para evitar la pérdida de paquetes y la congestión.

El QP (Queue Pair) es la unidad de comunicación fundamental en la tecnología RDMA. Consiste en un par de colas: la SQ (cola de envío) y la RQ (cola de recepción). Cuando los usuarios llaman a las API para enviar o recibir datos, esencialmente colocan los datos en el QP. A continuación, las solicitudes de la QP se procesan una a una mediante sondeo.

Las ventajas de"CBFC" puede resumirse en tres puntos principales:

1. Evita la congestión: Mediante el ajuste dinámico del crédito y la transmisión sin pérdidas, CBFC evita eficazmente la congestión de la red y la pérdida de paquetes.

2. Mejora la eficiencia:El emisor puede transmitir datos continuamente sin esperar acuses de recibo hasta que se agote el crédito, lo que aumenta la eficiencia de la transferencia de datos.

3.Auto-configuración:El mecanismo de control de flujo se activa automáticamente tras la instalación física de los dispositivos InfiniBand, sin necesidad de configuración manual por parte del usuario.

Como es evidente, InfiniBand define sus propios formatos de Capa 1-4 (Física, Enlace, Red, Transporte), constituyendo un protocolo de red completo. El control de flujo de extremo a extremo es la base para enviar y recibir paquetes de red InfiniBand, lo que permite la realización de una red sin pérdidas altamente eficaz.

Por supuesto, la consecución de la red de alta velocidad y sin pérdidas de InfiniBand también se basa en tecnologías y funciones como Socket Direct, Adaptive Routing, Subnet Manager (SM) para la gestión de subredes, partición de redes y el motor SHARP (Scalable Hierarchical Aggregation and Reduction Protocol) para la optimización de redes. Juntos, estos componentes proporcionan su característico alto rendimiento, baja latencia y fácil escalabilidad.

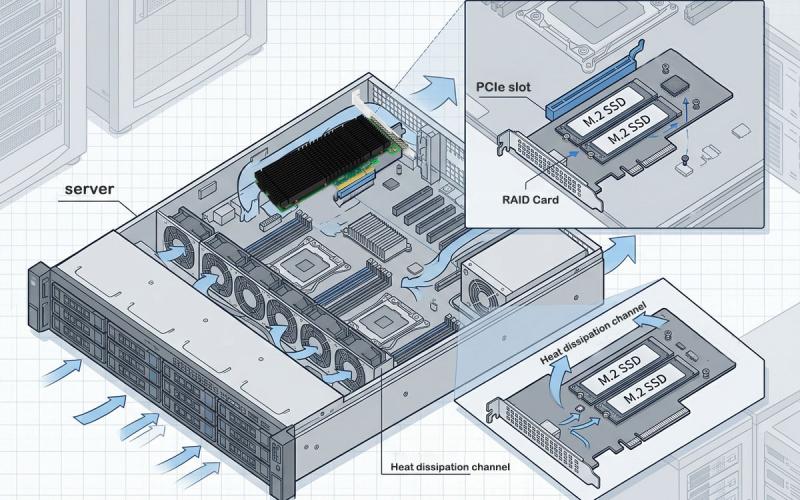

![]()