I. Mạng InfiniBand là gì?

InfiniBand, thường được viết tắt là “IB”, là một tiêu chuẩn truyền thông mạng và là một trong những giao thức triển khai công nghệ RDMA (Truy cập bộ nhớ trực tiếp từ xa). Tiêu chuẩn này sử dụng công nghệ tín hiệu vi sai tốc độ cao và cơ chế truyền tải song song đa kênh. Mục tiêu chính của nó là mang lại “hiệu suất cao, độ trễ thấp và độ tin cậy cao”.

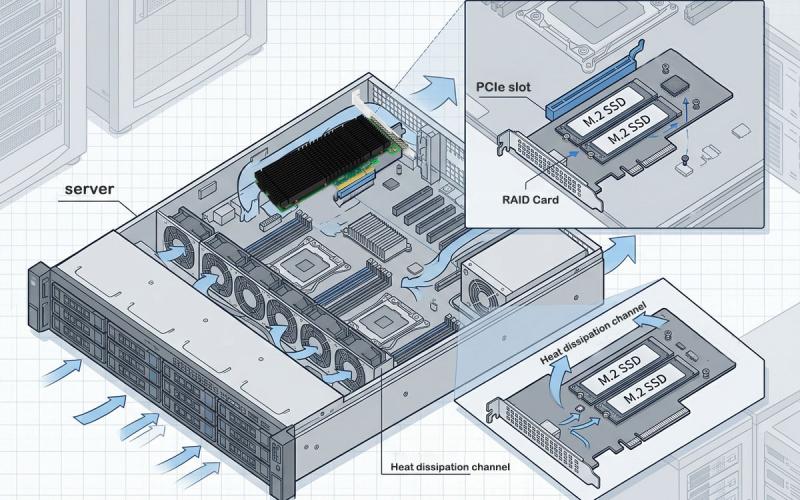

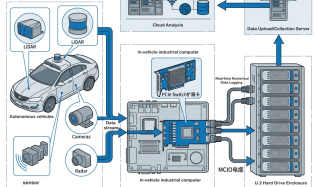

InfiniBand là một công nghệ kết nối chuyên dụng cho tính toán hiệu suất cao (HPC) trong lĩnh vực máy chủ. Công nghệ này có thông lượng cực cao và độ trễ cực thấp, được sử dụng để kết nối dữ liệu giữa các máy tính (ví dụ: sao chép, khối lượng công việc phân tán). InfiniBand cũng được sử dụng làm kết nối trực tiếp hoặc chuyển mạch giữa các máy chủ và hệ thống lưu trữ (như SAN và lưu trữ gắn trực tiếp), cũng như giữa các hệ thống lưu trữ với nhau. Ngoài ra, nó còn hỗ trợ giao tiếp giữa các máy chủ và mạng (như LAN, WAN và Internet). Công nghệ này được sử dụng rộng rãi trong các trung tâm dữ liệu và lĩnh vực HPC/lưu trữ. Sau đó, với sự phát triển của trí tuệ nhân tạo, nó đã trở thành công nghệ kết nối mạng được ưa chuộng để kết nối các máy chủ GPU.

II. Lịch sử phát triển của InfiniBand

Vào đầu những năm 1990, Intel đã tiên phong trong việc đưa thiết kế bus PCI vào kiến trúc máy tính cá nhân tiêu chuẩn nhằm hỗ trợ số lượng thiết bị ngoại vi ngày càng gia tăng. Tuy nhiên, khi CPU, bộ nhớ, ổ cứng và các thành phần khác được nâng cấp nhanh chóng, sự phát triển chậm chạp của bus PCI đã trở thành điểm nghẽn cho toàn bộ hệ thống. Để giải quyết vấn đề này, các gã khổng lồ trong ngành CNTT bao gồm Compaq, Dell, HP, IBM, Intel, Microsoft và Sun, cùng với hơn 180 công ty khác, đã cùng nhau thành lập **IBTA (Hiệp hội Thương mại InfiniBand)**.

Mục đích của IBTA là nghiên cứu các công nghệ thay thế mới để thay thế PCI và giải quyết vấn đề tắc nghẽn truyền dẫn của nó. Do đó, vào năm 2000, **Tiêu chuẩn Kiến trúc InfiniBand phiên bản 1.0** đã chính thức được công bố. Tiêu chuẩn này đã giới thiệu giao thức RDMA, mang lại độ trễ thấp hơn, băng thông lớn hơn, độ tin cậy cao hơn và cho phép hiệu suất I/O mạnh mẽ hơn đáng kể, từ đó khẳng định vị thế của nó như một tiêu chuẩn mới cho công nghệ kết nối hệ thống.

Khi nhắc đến InfiniBand, người ta không thể không nhắc đến một công ty của Israel – **Mellanox** (tên tiếng Trung: , dễ nhớ là "bán ốc vít"). Được thành lập tại Israel vào tháng 5 năm 1999 bởi một số cựu nhân viên của Intel và Galileo Technology, Mellanox đã gia nhập liên minh công nghiệp InfiniBand ngay sau khi thành lập. Năm 2001, họ đã ra mắt sản phẩm InfiniBand đầu tiên.

Năm 2002, phe InfiniBand phải đối mặt với một cuộc biến động lớn. Intel đã “rời bỏ con thuyền”, quyết định chuyển hướng phát triển sang **PCI Express (PCIe)**, công nghệ được ra mắt vào năm 2004. Một gã khổng lồ khác là Microsoft cũng rút lui khỏi việc phát triển InfiniBand. Mặc dù các công ty như Sun và Hitachi vẫn tiếp tục cam kết, tương lai của InfiniBand đã bị phủ bóng đen.

Từ năm 2003, InfiniBand đã chuyển hướng sang một lĩnh vực ứng dụng mới: “kết nối cụm máy tính”. Năm 2005, công nghệ này lại tìm thấy một ứng dụng mới khác: “kết nối thiết bị lưu trữ”. Sau năm 2012, nhờ sự tăng trưởng liên tục của nhu cầu về tính toán hiệu suất cao (HPC), công nghệ InfiniBand đã bứt phá mạnh mẽ, liên tục gia tăng thị phần.

Khi công nghệ InfiniBand dần trở nên phổ biến, Mellanox cũng phát triển và trở thành"nhà lãnh đạo thị trường" trong lĩnh vực InfiniBand. Năm 2010, Mellanox sáp nhập với Voltaire, khiến Mellanox (được NVIDIA mua lại vào năm 2019) và QLogic (được Intel mua lại vào năm 2012) trở thành các nhà cung cấp InfiniBand chính.

Năm 2013, Mellanox đã mua lại công ty công nghệ quang tử silicon Kotura và nhà sản xuất chip kết nối quang song song IPtronics, qua đó tiếp tục củng cố danh mục sản phẩm của mình trong ngành.

Năm 2015, thị phần của công nghệ InfiniBand trong"TOP500" Danh sách các siêu máy tính lần đầu tiên vượt qua mốc 50%. Điều này đánh dấu lần đầu tiên InfiniBand vượt qua công nghệ Ethernet, trở thành"công nghệ kết nối cụm được ưa chuộng nhất cho siêu máy tính".

Đến năm 2015, Mellanox đã nắm giữ một"chiếm 80% thị phần" của thị trường InfiniBand toàn cầu. Phạm vi kinh doanh của họ đã mở rộng từ chip sang bao quát toàn bộ lĩnh vực: bộ điều hợp mạng, bộ chuyển mạch/cổng kết nối, hệ thống truyền thông từ xa và cáp/mô-đun, giúp họ khẳng định vị thế là nhà cung cấp mạng đẳng cấp thế giới.

Năm 2019, NVIDIA đã thực hiện một bước đi quan trọng khi mua lại Mellanox với giá"6,9 tỷ đô la". Jensen Huang, Giám đốc điều hành (CEO) của NVIDIA, cho biết: "Đây là sự hợp nhất của hai công ty hàng đầu thế giới trong lĩnh vực tính toán hiệu suất cao. NVIDIA tập trung vào tính toán tăng tốc, trong khi Mellanox tập trung vào kết nối và lưu trữ." Nhìn lại, NVIDIA đã thể hiện tầm nhìn xa trông rộng đáng kinh ngạc: việc huấn luyện các mô hình quy mô lớn phụ thuộc rất nhiều vào các cụm máy tính hiệu suất cao, và mạng InfiniBand là"đối tác lý tưởng" đối với các cụm như vậy.

III. Cách thức hoạt động của InfiniBand

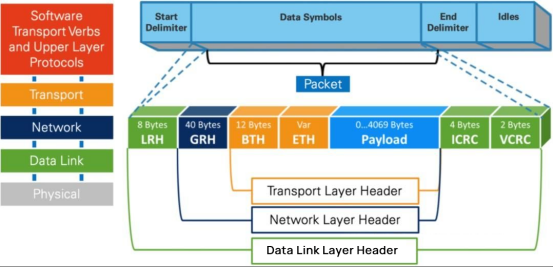

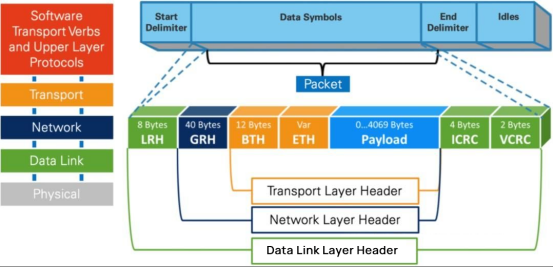

Nguyên lý hoạt động của InfiniBand có thể khá phức tạp đối với những người không chuyên về mạng. Người mới bắt đầu có thể tìm hiểu những kiến thức cơ bản hoặc bỏ qua phần này. Giao thức InfiniBand cũng áp dụng một"kiến trúc nhiều lớp", trong đó mỗi lớp hoạt động độc lập và cung cấp dịch vụ cho lớp ở trên nó.

Lớp vật lý: Xác định cách các tín hiệu bit được ghép thành các ký hiệu trên liên kết vật lý, sau đó thành các khung, các ký hiệu dữ liệu và phần dữ liệu lấp đầy giữa các gói tin. Lớp này mô tả chi tiết các giao thức tín hiệu để xây dựng các gói tin hợp lệ, v.v.

Lớp liên kết: Xác định định dạng của các gói dữ liệu và các giao thức điều khiển hoạt động của gói dữ liệu, chẳng hạn như điều khiển luồng, định tuyến, mã hóa, giải mã, v.v.

Lớp mạng: Thực hiện định tuyến bằng cách thêm Tiêu đề Định tuyến Toàn cầu (GRH) dài 40 byte vào gói tin. Trong quá trình chuyển tiếp, các bộ định tuyến chỉ thực hiện kiểm tra CRC biến đổi, đảm bảo rằng"tính toàn vẹn của quá trình truyền dữ liệu từ đầu đến cuối".

Lớp Vận chuyển: Chuyển các gói tin đến một cặp hàng đợi (QP) cụ thể và hướng dẫn QP cách xử lý gói tin. Hệ thống truyền tải mạng InfiniBand sử dụng công nghệ Kiểm soát luồng dựa trên tín dụng (CBFC) để đảm bảo độ tin cậy và hiệu quả trong việc truyền dữ liệu. Cơ chế này quản lý tín dụng (đại diện cho khối lượng dữ liệu mà người nhận có thể chấp nhận) giữa người gửi và người nhận nhằm ngăn chặn tình trạng mất gói tin và tắc nghẽn.

QP (Queue Pair) là đơn vị giao tiếp cơ bản trong công nghệ RDMA. Nó bao gồm một cặp hàng đợi: SQ (Send Queue) và RQ (Receive Queue). Khi người dùng gọi các API để gửi hoặc nhận dữ liệu, về cơ bản họ sẽ đưa dữ liệu vào QP. Các yêu cầu trong QP sau đó sẽ được xử lý lần lượt theo phương thức thăm dò.

Những ưu điểm của"CBFC" Công nghệ có thể được tóm tắt trong ba điểm chính:

1. Ngăn ngừa tắc nghẽn: Nhờ cơ chế điều chỉnh tín dụng động và truyền tải không mất gói, CBFC giúp ngăn ngừa hiệu quả tình trạng tắc nghẽn mạng và mất gói dữ liệu.

2. Nâng cao hiệu quả: Người gửi có thể liên tục truyền dữ liệu mà không cần chờ xác nhận cho đến khi hết dung lượng, từ đó nâng cao hiệu quả truyền dữ liệu.

3. Tự động cấu hình: Cơ chế kiểm soát lưu lượng sẽ tự động kích hoạt ngay sau khi lắp đặt các thiết bị InfiniBand, không yêu cầu người dùng phải cấu hình thủ công.

Như đã thấy, InfiniBand định nghĩa các định dạng riêng cho các lớp 1-4 (Vật lý, Kết nối, Mạng, Vận chuyển), tạo thành một giao thức mạng hoàn chỉnh. Kiểm soát luồng dữ liệu từ đầu đến cuối là nền tảng cho việc gửi và nhận các gói tin mạng InfiniBand, giúp hiện thực hóa một mạng không mất gói tin với hiệu quả cao.

Tất nhiên, việc xây dựng mạng InfiniBand với tốc độ cao và không mất gói tin còn phụ thuộc vào các công nghệ và tính năng như Socket Direct, Adaptive Routing, Subnet Manager (SM) để quản lý mạng con, phân vùng mạng, và bộ xử lý SHARP (Scalable Hierarchical Aggregation and Reduction Protocol) nhằm tối ưu hóa mạng. Khi kết hợp với nhau, các thành phần này mang lại những đặc trưng nổi bật của InfiniBand: hiệu suất cao, độ trễ thấp và khả năng mở rộng dễ dàng.

![]()