I. Что такое сеть InfiniBand?

InfiniBand, часто сокращенно называемая «IB», представляет собой стандарт сетевой связи и один из протоколов, реализующих технологию RDMA (Remote Direct Memory Access). Она использует технологию высокоскоростной дифференциальной передачи сигналов и механизмы многоканальной параллельной передачи. Ее основными целями являются обеспечение «высокой производительности, низкой задержки и высокой надежности».

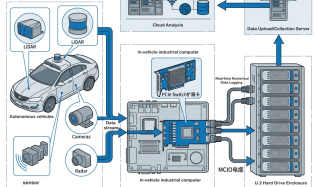

InfiniBand — это технология межсетевого соединения, предназначенная для высокопроизводительных вычислений (HPC) в серверной сфере. Она отличается чрезвычайно высокой пропускной способностью и исключительно низкой задержкой, используется для межкомпьютерного обмена данными (например, репликация, распределенные рабочие нагрузки). InfiniBand также применяется в качестве прямого или коммутируемого соединения между серверами и системами хранения (такими как SAN и системы хранения с прямым подключением), а также между самими системами хранения. Кроме того, она облегчает обмен данными между серверами и сетями (такими как локальные и глобальные сети, а также Интернет). Она широко используется в центрах обработки данных и в сферах HPC и хранения данных. Впоследствии, с развитием искусственного интеллекта, она стала предпочтительной технологией сетевого соединения для подключения серверов с графическими процессорами.

II. История развития InfiniBand

В начале 1990-х годов компания Intel первой внедрила конструкцию шины PCI в стандартную архитектуру ПК для поддержки растущего числа внешних устройств. Однако по мере быстрого обновления процессоров, памяти, жестких дисков и других компонентов более медленное развитие шины PCI стало узким местом для всей системы. Чтобы решить эту проблему, гиганты ИТ-индустрии, включая Compaq, Dell, HP, IBM, Intel, Microsoft и Sun, вместе с более чем 180 другими компаниями, совместно основали **IBTA (InfiniBand Trade Association)**.

Целью IBTA было исследование новых альтернативных технологий для замены PCI и решения проблемы узкого места в передаче данных. В результате в 2000 году была официально выпущена **спецификация архитектуры InfiniBand версии 1.0**. Она представила протокол RDMA, предлагающий меньшую задержку, большую пропускную способность, более высокую надежность и обеспечивающий значительно более мощную производительность ввода-вывода, что утвердило его в качестве нового стандарта для технологии межсистемных соединений.

Разговор об InfiniBand неизбежно приводит к израильской компании — **Mellanox** (китайское название: , легко запоминающееся как «продажа винтов»). Основанная в Израиле в мае 1999 года несколькими бывшими сотрудниками Intel и Galileo Technology, Mellanox присоединилась к отраслевому альянсу InfiniBand вскоре после его создания. В 2001 году они выпустили свой первый продукт InfiniBand.

В 2002 году лагерь InfiniBand столкнулся с серьезными потрясениями. Intel «покинула корабль», решив перенести фокус разработок на **PCI Express (PCIe)**, который был запущен в 2004 году. Другой гигант, Microsoft, также вышел из разработки InfiniBand. Хотя такие компании, как Sun и Hitachi, остались верны проекту, будущее InfiniBand оказалось под угрозой.

Начиная с 2003 года, InfiniBand переориентировался на новую область применения: «межкластерное соединение». В 2005 году он нашел еще одно новое применение: «подключение устройств хранения». После 2012 года, под влиянием непрерывного роста спроса на высокопроизводительные вычисления (HPC), технология InfiniBand резко ускорила развитие, неуклонно увеличивая свою долю рынка.

По мере того как технология InfiniBand постепенно выходила на первый план, компания Mellanox также росла и стала «лидером рынка» в сфере InfiniBand. В 2010 году Mellanox объединилась с Voltaire, в результате чего Mellanox (приобретенная NVIDIA в 2019 году) и QLogic (приобретенная Intel в 2012 году) остались основными поставщиками InfiniBand.

В 2013 году Mellanox приобрела компанию Kotura, специализирующуюся на технологии кремниевой фотоники, и производителя чипов для параллельных оптических межсоединений IPtronics, еще больше укрепив свой отраслевой портфель.

В 2015 году доля технологии InfiniBand в списке суперкомпьютеров «TOP500» впервые превысила 50 %. Это ознаменовало первоначальное превосходство InfiniBand над технологией Ethernet, став «предпочтительной технологией кластерной связи для суперкомпьютеров».

К 2015 году Mellanox занимала «80% долю» мирового рынка InfiniBand. Сфера деятельности компании расширилась с производства чипов до охвата всего спектра: сетевые адаптеры, коммутаторы/шлюзы, системы удаленной связи, а также кабели/модули, что позволило ей закрепиться в качестве сетевого поставщика мирового уровня.

В 2019 году NVIDIA сделала значительный шаг, приобретя Mellanox за «6,9 млрд долларов». Дженсен Хуанг, генеральный директор NVIDIA, заявил: «Это объединение двух ведущих мировых компаний в области высокопроизводительных вычислений. NVIDIA фокусируется на ускоренных вычислениях, а Mellanox — на межсетевых соединениях и хранении данных». Оглядываясь назад, можно сказать, что NVIDIA продемонстрировала замечательную дальновидность: обучение больших моделей в значительной степени зависит от высокопроизводительных вычислительных кластеров, а сети InfiniBand являются «оптимальным партнером» для таких кластеров.

III. Как работает InfiniBand

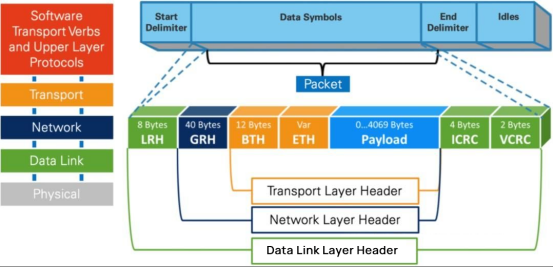

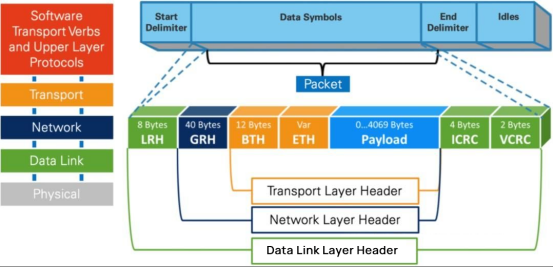

Принципы работы InfiniBand могут показаться сложными для тех, кто не является специалистом в области сетей. Новички могут ознакомиться с основами или пропустить этот раздел. Протокол InfiniBand также использует «многоуровневую архитектуру», причем каждый уровень является независимым и предоставляет услуги уровню, расположенному выше него.

Физический уровень: определяет, как битовые сигналы собираются в символы на физическом канале, затем в кадры, символы данных и заполнение данными между пакетами. Он подробно описывает протоколы сигнализации для построения допустимых пакетов и т. д.

Канальный уровень: определяет формат пакетов данных и протоколы для работы с пакетами, такие как управление потоком, маршрутизация, кодирование, декодирование и т. д.

Сетевой уровень: выполняет маршрутизацию путем добавления к пакету 40-байтового глобального заголовка маршрута (GRH). Во время пересылки маршрутизаторы выполняют только переменную CRC-проверку, обеспечивая «целостность передачи данных от конца до конца».

Транспортный уровень: Доставляет пакеты в определенную пару очередей (QP) и дает QP инструкции по обработке пакета. Сетевой транспорт InfiniBand использует технологию управления потоком на основе кредитов (CBFC) для обеспечения надежности и эффективности передачи данных. Этот механизм управляет кредитом (представляющим объем данных, который может принять получатель) между отправителем и получателем, чтобы предотвратить потерю пакетов и перегрузку.

QP (пара очередей) является основной единицей связи в технологии RDMA. Она состоит из пары очередей: SQ (очередь отправки) и RQ (очередь приема). Когда пользователи вызывают API для отправки или получения данных, они фактически помещают данные в QP. Запросы в QP затем обрабатываются по одному в режиме опроса.

Преимущества технологии «CBFC» можно обобщить в трех основных пунктах:

1. Предотвращение перегрузки: благодаря динамической корректировке кредита и передаче без потерь CBFC эффективно предотвращает перегрузку сети и потерю пакетов.

2. Повышение эффективности: отправитель может непрерывно передавать данные, не ожидая подтверждений, до тех пор, пока кредит не будет исчерпан, что повышает эффективность передачи данных.

3. Автоконфигурация: механизм управления потоком автоматически активируется при физической установке устройств InfiniBand, не требуя ручной настройки со стороны пользователя.

Как видно, InfiniBand определяет собственные форматы уровней 1–4 (физический, канальный, сетевой, транспортный), составляющие полный сетевой протокол. Сквозное управление потоком является основой для отправки и получения сетевых пакетов InfiniBand, позволяя реализовать высокоэффективную сеть без потерь.

Конечно, создание высокоскоростной сети InfiniBand без потерь данных также зависит от таких технологий и функций, как Socket Direct, адаптивная маршрутизация, Subnet Manager (SM) для управления подсетями, разбиение сети на сегменты и механизм SHARP (Scalable Hierarchical Aggregation and Reduction Protocol) для оптимизации сети. В совокупности эти компоненты обеспечивают характерные для этой технологии высокую производительность, низкую задержку и легкую масштабируемость.

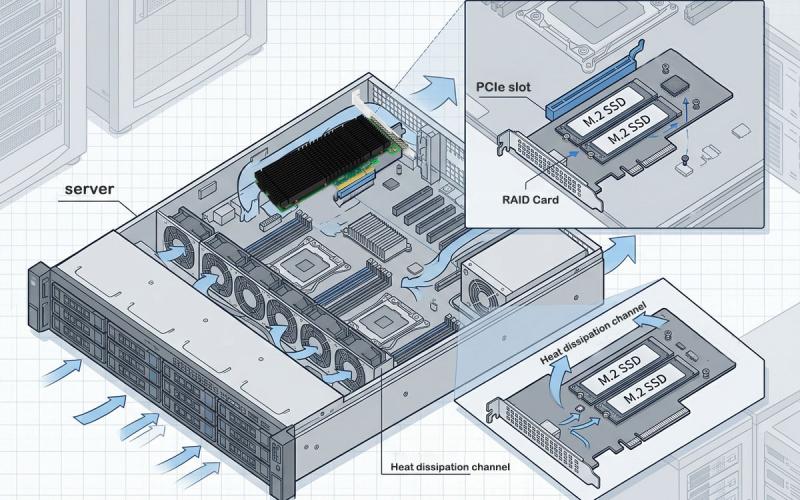

![]()